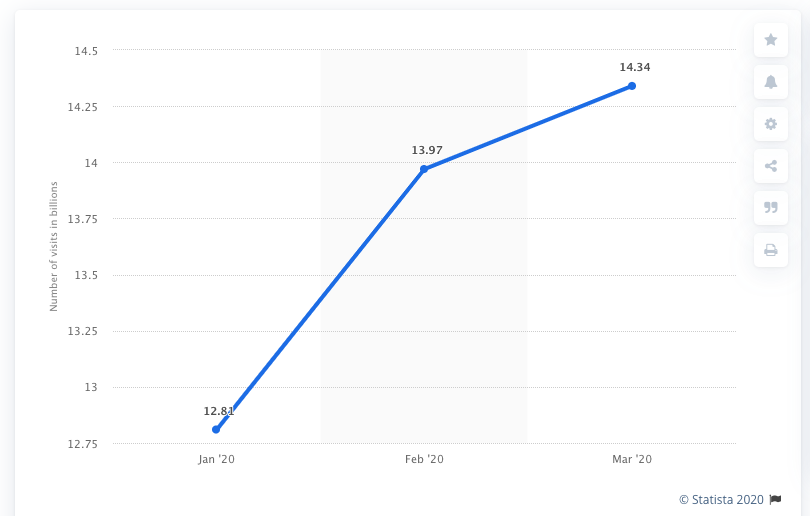

2019年単体でみると、ECサイトでの売上は 世界の小売業界全体の売上の14%を占め、これは2020年も継続して増加しています。この数ヶ月で消費者の行動は変化を余儀なくされ、これがECサイトで発生した大量のトラフィック増加をもたらしています。実際に、2020年1月から3月までの間でECサイトの訪問者数は128億1千万人から143億4千万人と世界規模で約20億人増加しています。

オンラインショッピングへのさらなる需要増加が見込まれることから、パフォーマンスの良いECサイトの必要性がかつてないほどに高まっています。一方で、その規模と複雑性ゆえにECサイトは最適化が最も難しい業種の1つであり、ウェブ領域で見られる典型的なSEO上の問題に特有の課題に直面しているのも事実です。

ECサイトが直面するSEO上のよくある問題を把握するために、DeepCrawlでは大規模ECサイトの数多くのクロールデータを分析し、テクニカルSEOの知見を活用してこれらの問題の検出・解決方法をまとめました。

期限切れの商品ページ

どの商品にも当然期限があり、それを過ぎるとそのページは削除されるのが一般的ですが、これらの商品ページが商品一覧ページよりも多くのバックリンクを集めている場合が多くあります。有効期間切れの商品ページを関連性の高い類似商品ページへリダイレクトするとその計測が難しくなり、関連するカテゴリーへリダイレクトすると設定と管理が困難になります。

多くの場合、有効期間切れの商品ページはただ削除されて404ステータスコードを返し、これにより獲得したバックリンクを失うことになるか、またはホームページなどの一般的なページにリダイレクトされます。これは満足度の低いユーザー体験でしかなく、見込み客は代わりに競合のサイトにお金を落とすことになるかもしれません。これらのページもまた、獲得したバックリンクのオーソリティを失う可能性が高く、結果として内部リンクされた他のページに加えサイト全体にも影響を及ぼす可能性があります。

期限切れの商品の見つけ方

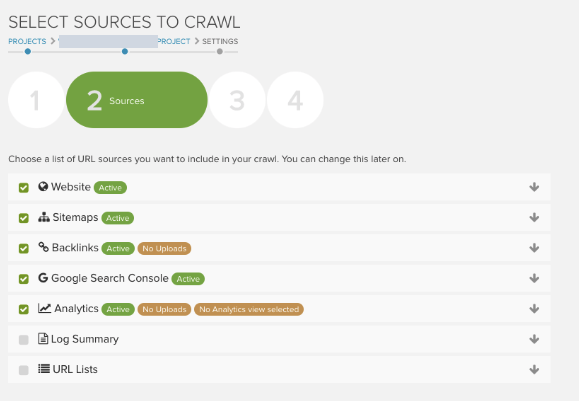

これらのページを検出する最善の方法は、古い商品ページURLやバックリンクのあるURL、長い日付範囲を指定してGoogleサーチコンソールのクロールを行い、ページが404またはリダイレクトを返しているか確認することです。これは、DeepCrawl内の設定で、Majestic連携に加えて、GoogleアナリティクスとGoogleサーチコンソールアカウントも連携させる追加クロール設定を行うことで可能になります。クロールが完了したら、インデックスレポート内でこれらのページを見つけることができるようになります。

この問題の解決方法

クロールでこの問題を検出した場合、最も関連性の高い関連商品や商品一覧ページへのリダイレクトを行うことが最善の策といえるでしょう。そして最もバックリンクを集めており、多くのトラフィックを集めているページを優先すると良いでしょう。また、開発チームと協力し、商品の期限が切れたらすぐこうした対応をできるようにプラットフォームを改修しておくと便利です。

複数のURLルートやパラメータ

商品詳細ページには、例えばパラメータや値など複数のURLフォーマットからアクセス可能な場合があります。これら商品詳細ページが適切に正規化されておらず、かつサイト内部でリンクされている際には、重複を引き起こしてしまう場合があります。コンテンツ重複があると、検索結果に表示されるページとのカニバリゼーションを発生させることがあり、同一サイト内の複数のページが同じキーワードで競合してしまいます。これにより、重要なページがユーザーから全く見られない、もしくは関連性が低いページにユーザーを誘導してしまうなどの結果を招く可能性があります。

検索エンジンに同じページの複数のバージョンをクロールさせると、サイトのクロール効率に重大な影響を与え、同時に様々なページバージョンにわたるシグナルを弱めることになります。これによりサイト全体のパフォーマンスが制限され、検索エンジンボットとユーザーの両方に混乱を生じさせるおそれがあります。これはまた、特に検索エンジンが同じコンテンツを複数回クロールすることになる大規模サイトの場合に、クロールバジェットの浪費につながる可能性があります。

DeepCrawlの重複コンテンツに関するガイドで、重複コンテンツと検索エンジンの重複コンテンツの処理方法について詳しくご覧いただけます。

複数のURLルートの検出方法

重複コンテンツを検出することは、複数のURLパラメータが原因で発生し得る問題を見つけるための最初のステップに適しており、DeepCrawl内には重複コンテンツを検出するために利用できるレポート(重複コンテンツセットや重複タイトル、重複ディスクリプションなど)がいくつもあります。基準となるサイト構造を理解し、これらが正しく設定されていることに加え、そのサイト構造がサイトマップとサイトでの内部リンクに含まれていることを確認することも大切です。

この問題の解決方法

この問題にはいくつかの解決方法があります。検索エンジンとユーザーの両方に好ましい方法は、canonicalタグが推奨のURL形式を指定しており、この推奨URL形式をサイトマップ内および内部リンクで使用することです。

また、重複URLから推奨のURLへ301リダイレクトを設定することもできます。これを行うことで、重複ページが検索結果でお互いに競合し合うのを防ぐだけでなく、検索エンジンへのシグナルをまとめることができます。しかし、リダイレクトを検出するために検索エンジンが各ページをクロールする必要があることから、この方法はクロールバジェットの問題の解決法にはなりません。また、検索エンジンのクローラーから見たページの見つけやすさに影響を及ぼすため、リダイレクトチェーンが作成されていないことを確認すると良いでしょう。

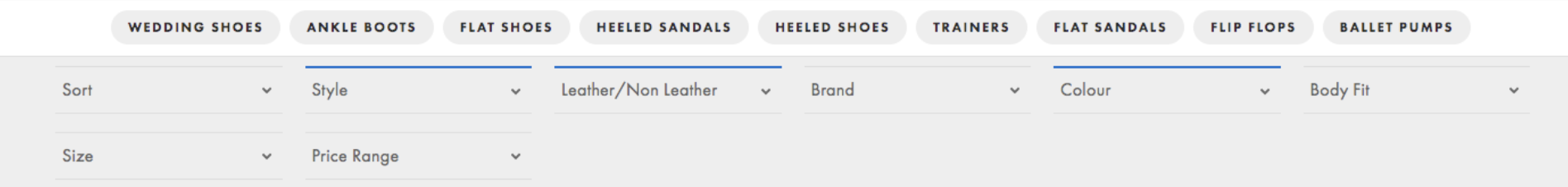

複数ファセット選択

数多くのサイトでユーザーは同時に複数のファセットを選択できるようになっており、これにより一般的には大量のファセットの選択肢を不均等に生じさせることになります。これでは関連性の高い検索クエリをターゲティングしないページ、すなわちSEOにとって不要なページを作成してしまうことになってしまいます。たとえそのページがnoindexおよびnofollowタグで管理されていたとしても、依然としてクロールバジェットの浪費になってしまいます。

複数ファセット選択ページの検出方法

これらのページを見つけるための最初のステップは、複数ファセット選択で使用されているURLパターンを検出することです。これらのURLには概して「?」や「#」などの文字やクエリ文字列を処理するパラメーターが含まれているものですが、スラッシュの後に続くフォルダのレベルにも存在する可能性があります。これらのURLの検出が済んだら、次にこれらのURLをクロールして、たどられたリンクでインデックス可能なページと、GSCから検索インプレッションのあるページを確認することができます。

この問題の解決方法

この問題を解決するには、推奨バージョンをGoogleへ伝えるために必ずcanonicalタグを使用し、これら複数ファセットのあるページへのリンクがnofollowされ、かつこれらのページがnoindexされているようにしてください。これにより複数ファセットページがGoogleにインデックスされることを防ぐとともに、検索エンジンが正規化URLを理解しやすくなります。

また、検索エンジンクローラーのアクセスやクロールを完全に防ぐそして究極的にはインデックスも完全にブロックするために、robots.txt内で対象のURLをdisallow設定することを検討しても良いかもしれません。この方法はクロールバジェットの問題に効果的ですが、対象のファセットページから内部リンクされている他のページが他のクロール可能ページを経由してアクセスできるようにする必要があります。そうしなければ、その内部リンクされているページが検索エンジンからアクセスできなくなってしまいます。

非効率的なリンク構造

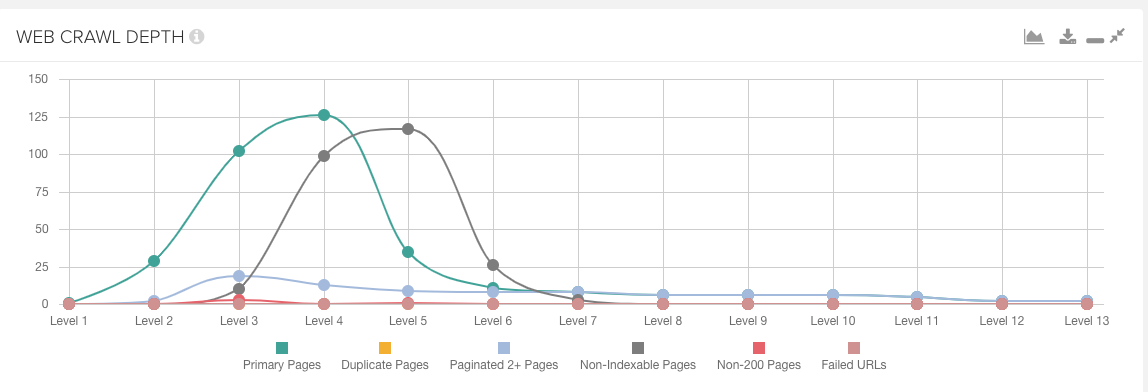

商品ページは、ホームページから4、5クリック必要なページの深い位置に配置されていることがあります。そのサイトが大規模ECサイトの場合、こうしたページはGoogleから検出されることもクロールされることもなく、結果としてインデックスされることもありません。つまりユーザーが商品を検索する際にそのページが表示されず、そのユーザーは代わりに競合のサイトを訪問してそこで購買を行う可能性があります。また、このようなページにおける内部リンクのオーソリティは比較的低くなると考えられており、これはサイト全体で内部リンクされている他のページに影響を与える可能性があります。

非効率的なリンク構造の検出方法

DeepCrawlでサイトのクリック深度の検出とサイト内の深い位置に埋もれているページの見直しを行うことができます。クロールにより検出された開始ページから直接リンクされているページはすべてレベル2となり、以降も同様です。つまりページのレベルとは、開始ページから内部リンクを経由してアクセスできる最短距離と一致します。

また、優先度の高いページの見直しを行い、ページ深度や現在の保有内部リンク数、内部リンクのリンク元を確認することもできます。

リンク構造の問題の解決方法

ホームページから4クリックよりも先に重要な商品ページがある際には、そのページまでの必要クリック数を減らすために、より目立つページに適切な内部リンクを設置するようにしましょう。 優先度が高いページについても、ユーザーと検索エンジンにとってこれらのページがより見つけやすく明確になるよう、サイト上で適切な内部リンクを追加できる箇所を再検討すると良いでしょう。

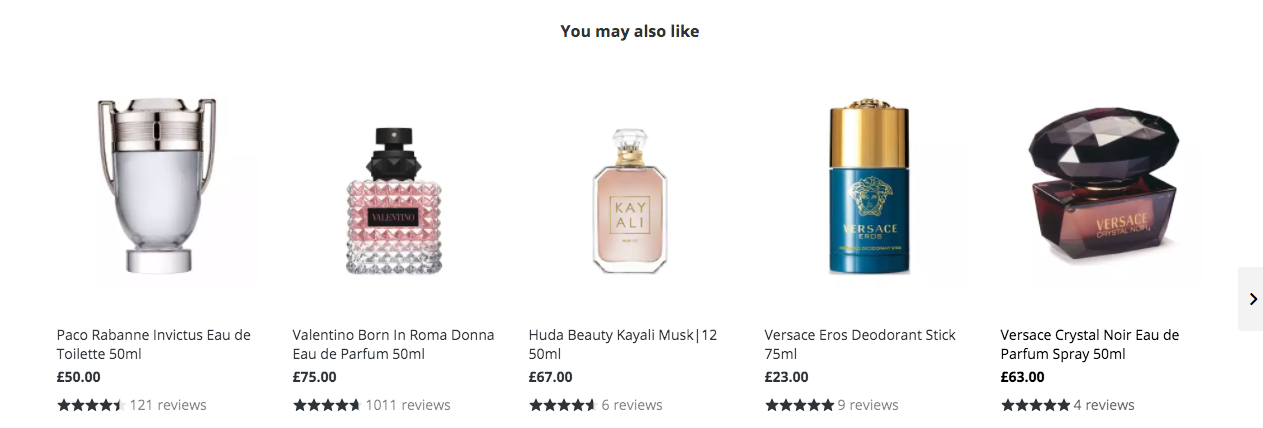

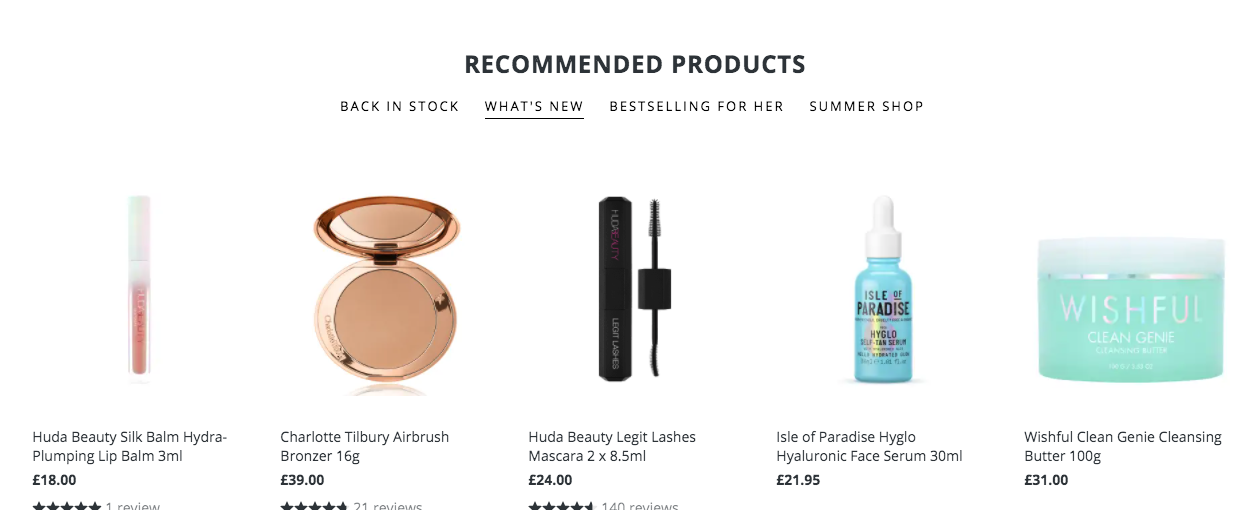

内部リンクを行う際のアイディア:「関連商品」、「この商品をチェックした人はこんな商品もチェックしています」、「一緒に購入されている商品」、またはサイト上の新商品、セール商品セクションへの配置

商品一覧ページの変動

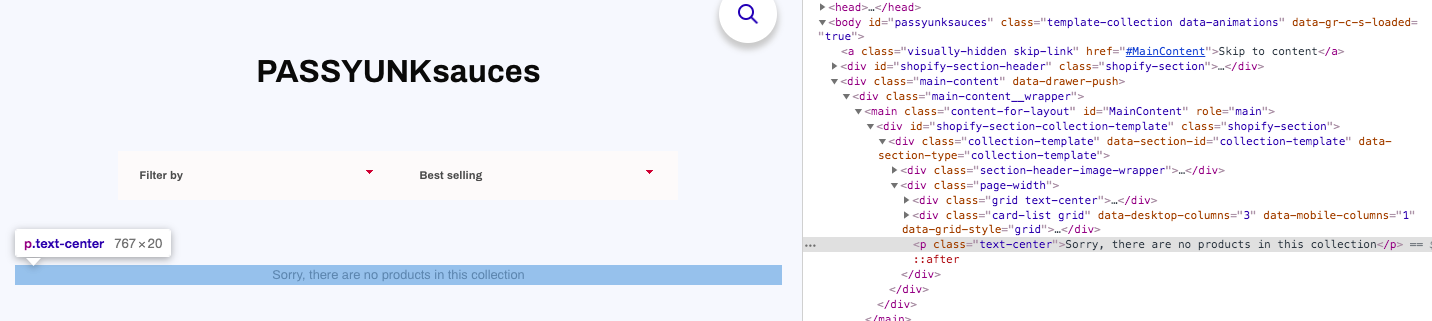

一覧ページは、在庫の変動に合わせて在庫ありの状態から在庫切れの状態に変わることが頻繁にあります。商品在庫の無い空のページがあると、ユーザー体験を阻害し、それはソフト404ページと見なされ、ランキングの表示順位が下がる可能性があります。

空の商品一覧ページの検出方法

空の商品一覧ページを検出する方法の1つは、商品数または在庫切れのエラーメッセージに対しカスタム抽出を設定することです。この設定をモニタリング用のクロールに追加することで、空の商品一覧ページが検出される度に通知を受けることができます。また、GSCのソースを使用してこれらのURLをクロールし、検索インプレッションのあるページだけでなく内部リンクされているページも把握することができます。

こちらのカスタム抽出ガイドでは、簡単な正規表現を使用しながら、DeepCrawlのカスタム抽出を使用してこれらのページを検出する方法を詳しく説明しています。

空の商品一覧ページの解決方法

商品数がn未満のページへの自動noindex設定と、商品数がn以上表示された場合のnoindexを削除を検討しましょう。

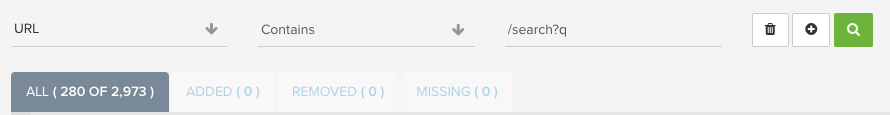

サイト内検索ページのインデックス

サイト内検索ページは、主なサイト分類やファセット、フィルタに含まれていないさらにニッチな内容をカバーする目的で採用されることがあります。しかし、サイト内検索を用意することで大量のURLが追加的に発生することになり、これらを注意して管理しなければ、他のページと競合しあうページが増えてしまいます。これらのページはサイトの容量を膨張させるとともに、Googleは内部検索で無限に生じるURLを実際にクロールすることになるためクロールバジェットに影響を及ぼすことにもなります。

インデックス可能な内部検索ページの検出方法

サイトに存在する可能性のあるインデックス可能な検索結果ページを検出するため、まずは内部検索のURL形式を把握する必要があります。多くの場合そのURLでは ?q や ?s のようなクエリパラメータが使用されています。その後、クロールを行いサイト上でインデックス可能な内部検索ページの数を把握するとともに、GSCのデータを使用してそれらのページが生成しているインプレッション数を確認することができます。

インデックス可能な内部検索ページの解決方法

この問題の解決策はいくつかありますが、まずGSCのキーワードを確認して同じキーワードに対しランキングの重複がないか、また内部検索の結果ページがこれらに含まれているか確認してください。あるクエリに対して高い検索需要がある場合、インデックス可能な検索ページの必要性を未然に防ぐため、対象の商品に対し詳細ページの作成を検討しても良いかもしれません。

これらのページがインデックスされるのを防ぐ1つの方法は、noindexタグ、nofollowタグを追加して検索エンジンクローラーに対しこれらのページをインデックスに追加するべきでないと伝える方法です。また、robots.txt内でこれらのページを完全に禁止し、そもそも検索エンジンがページにアクセスしたりクロールしたりできないようにすることも可能です。この方法は、クロールバジェットに関する問題の解決に役立ちます。

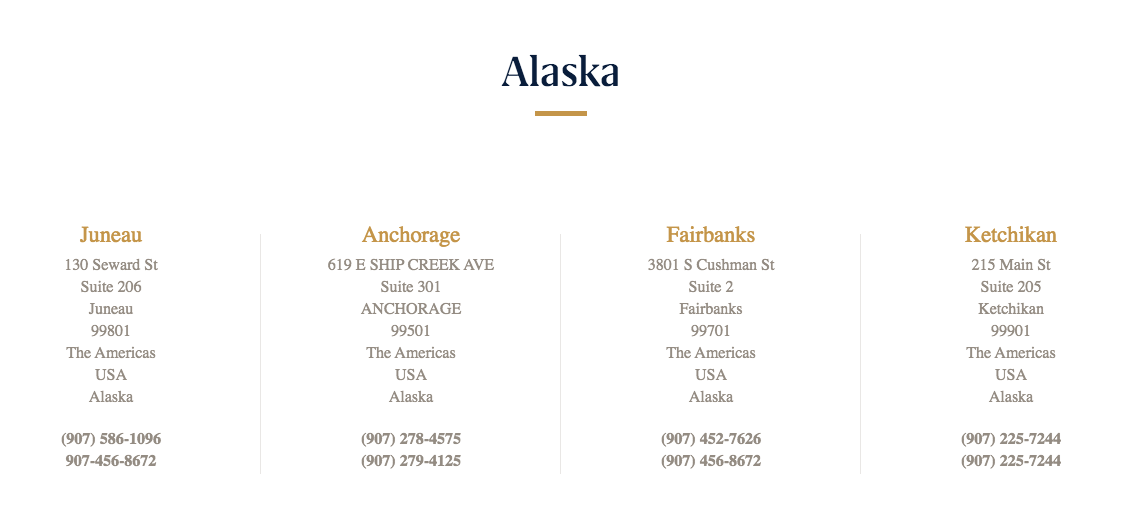

ロケーションページの見落とし

実際の店舗を持つECサイトでは、ロケーションページの重要性が見落とされることが頻繁にあります。ロケーションページがユーザーの入力する上方(例:郵便番号)に基づいて動的に生成され、かつそのページがサイトマップに存在しないために、店舗を持つECサイトのクロールでロケーションページが見つからないことが多々あります。また、全ての店舗一覧を掲載したロケーションページを1つだけ準備しているケースもあります。他には、アクセス可能なページは存在するがユーザーの役に立たない、またはページは存在して役に立つコンテンツがあるが内部リンクが全くされていないケースもあります。

これはつまりこの店舗は検索結果に表示されないだけでなくローカルパックにも表示されず、実店舗内でのお客様の購入の機会を逃していることになります。

ロケーションページ見落とし問題の検出方法

これらのページの見直しを行う方法で最も簡単なのは、サイト上のロケーションページを手作業で確認する方法です。データ生成のためにユーザー入力が必要か?内部リンクは設置されているか?ページは実際にユーザーの役に立っているか?という観点で確認すると良いでしょう。

また、クロールを実行してロケーションページが検出されるか確認したり、サイトマップを見直してロケーションページを含むようにしたり、GSCを確認してロケーションページがインデックスされているか確認したりすることもできます。

悪い例

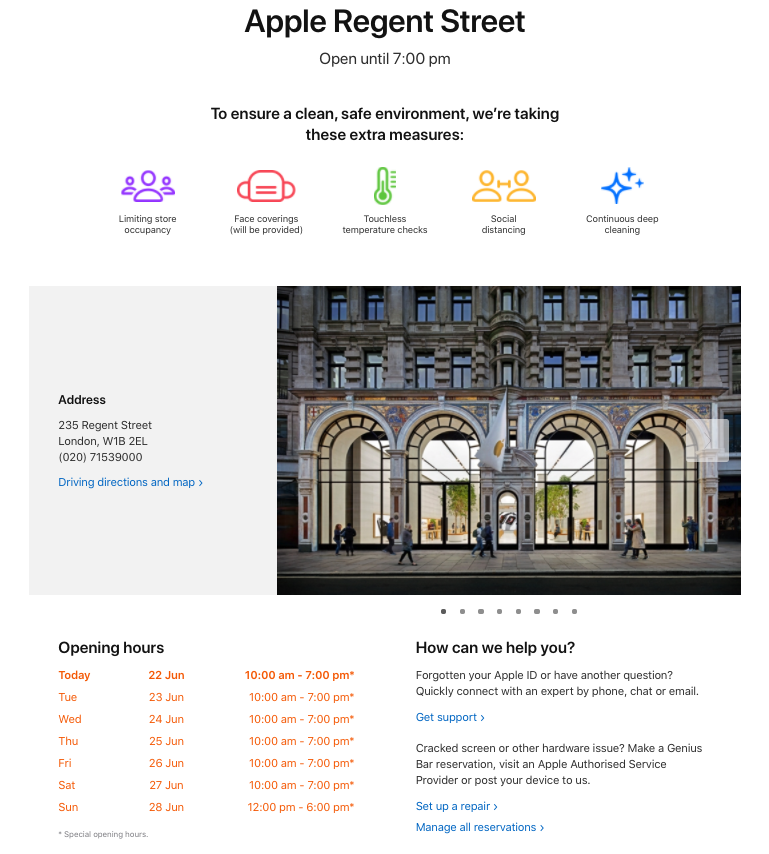

良い例

問題の解決方法

サイト内にリンクされたユニークなURLを使用してロケーションページを作成しましょう。そして、サイトマップにもこれらのロケーションページのURLを含めるようにしてください。これらのページには住所や電話番号、営業時間、サービス内容などユーザーにとって有益な情報を詳しく掲載するようにしましょう。特定の店舗にレビューが寄せられている場合は、LocalBusinessスキーママークアップだけでなくこれらのレビューも追加するようにしてください。

質の低いなコンテンツ

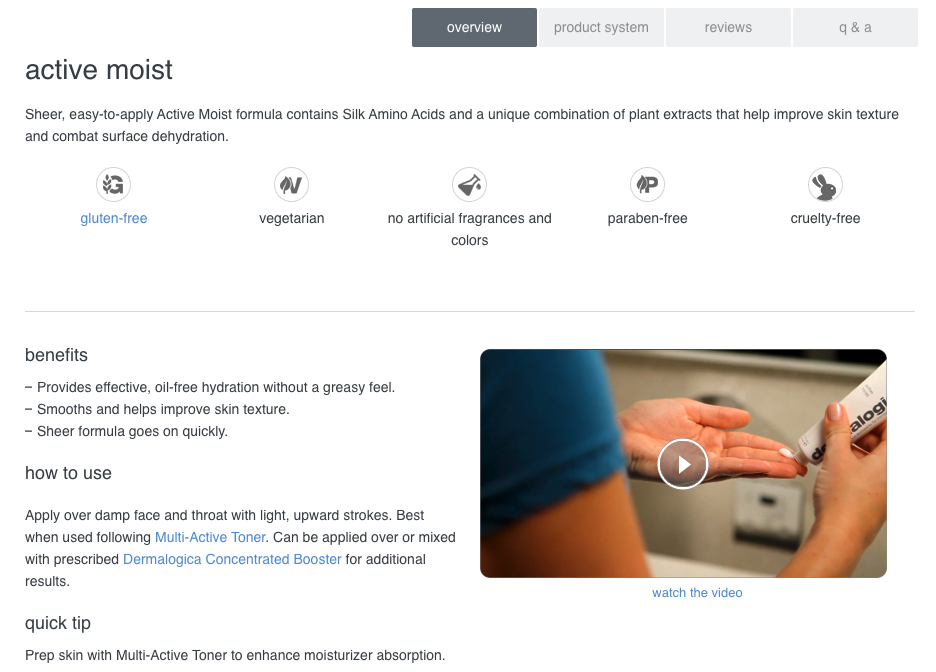

ECサイトでの主な課題は、特に商品ページ上のコンテンツをユーザーに対しユニークかつ役立つものにすることです。ほとんどのECサイトは製造元の商品詳細情報をコピーして貼り付けているだけであり、これらはユニークでなく便利な情報を提供するものではありません。そのためこれらのページの質が低いと見なされ、検索結果内でのオーソリティに悪影響を及ぼします。大規模サイトでは、その膨大なページ数とページ作成の自動化が一般的なためにこの問題を把握することが困難な場合があります。

Googleはページの質が低いと見なすと、そのページ、またはサイト全体にもペナルティを課すことがあります。その上、同じ商品を販売するECサイトは検索結果上での数多くの競争があります。ページ上で競合よりもより多くの情報を提供することが、SERPでの両社の獲得掲載順位の向上と売上の向上に差をつける要素となります。また、ユーザーファーストを考慮し、ユーザーに取ってもらいたい行動を考える必要があります。すなわち、ページがユーザーの高いエンゲージメントを獲得するものであり、かつ商品そのものや、なぜそれを買うべきかという点で多くの情報を提供するものではない場合、ユーザーがコンバージョンに至ることはおそらくないためです。

質の低いコンテンツの検出方法

質が低いと見なされる可能性のあるページの把握には、DeepCrawlの重複コンテンツと (内容が) 薄いコンテンツのレポートを確認してください。これらのレポートはコンテンツの質に問題がある可能性があるURLを表示し、サイト内での類似したページを見つけることができます。

質の低いコンテンツの解決方法

一般的なSEOベストプラクティスは、サイト上のすべてのページに、“商品の利点”や”商品の使用方法”のような役立つコンテンツを可能であれば補足的な画像や動画と合わせて提供することです。

これらは、特にトラフィックの水準や商品需要、そして他社との競争が増加するにつれてECサイトへと影響を与える可能性があるとDeepCrawlが考える、一般的なSEO問題のほんの一部に過ぎません。検索結果で成功を収めるだけでなく顧客を獲得してロイヤリティを維持するためには、サイトが簡単にアクセスでき、目指すゴールを達成するための良いユーザー体験と分かりやすいユーザージャーニーを提供するようにしましょう。

加えて、競合他社が彼らのサイトを定期的にモニタリング、発生する問題を修正、サイトを継続的に最適化している場合、競合他社が検索結果であなたのサイトよりも上位に掲載されるだけでなく、より高いトラフィックと最終的なコンバージョンを獲得することになり、あなたのサイトから顧客を奪っていく可能性もあります。

ビジネス全体のKPIにプラスの影響を与えると同時に、検索エンジンとユーザーの両方に最もインパクトを与える問題を特定することが成功に欠かせません。この記事で問題の解決方法とともに、問題を特定するきっかけを提供できていましたら幸いです。この記事のトピックに関して何か詳細な質問がございましたら、お気軽にお問い合わせください。

DeepCrawlはどのようにECサイトのSEOに役立つのか

弊社は世界中のECや小売ブランドの大企業を数多くお手伝いしており、これらのサイトのオーガニック検索への最適化においてよく陥る問題を熟知しています。DeepCrawlは、あなたのサイトが抱える特有の問題、そしてこの記事で挙げた問題の解決に役立つ最適のツールです。